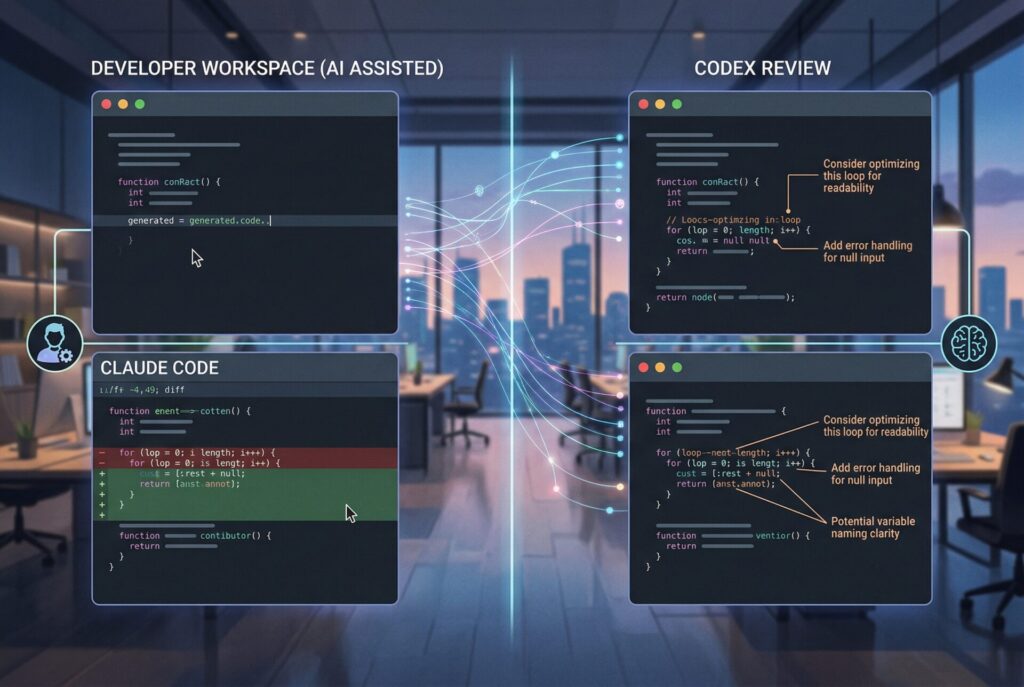

Det mest interessante ved OpenAIs nye Codex plugin til Claude Code er faktisk ikke, at to konkurrenter nu kan arbejde i samme terminal. Det interessante er, at review-leddet i et moderne udviklerworkflow pludselig bliver mere uafhængigt. Hvis du allerede skriver kode med Claude Code, kan du nu bede Codex om at lave en separat gennemgang, udfordre designvalg eller overtage en konkret redningsopgave, uden at du skal skifte værktøj, repo eller arbejdskontekst.

Det lyder måske som en lille integration. I praksis er det tættere på en ny arbejdsmåde. OpenAI har udgivet et officielt plugin, @openai/codex-plugin-cc, som lægger nye slash-kommandoer ind i Claude Code, blandt andet /codex:review, /codex:adversarial-review og /codex:rescue. Pointen er ikke bare bekvemmelighed. Pointen er, at man kan lade én model skrive eller forme løsningen og lade en anden model forsøge at pille den fra hinanden.

Fra “hjælp mig med koden” til et rigtigt review-loop

De fleste, der bruger AI til udvikling i dag, kender allerede mønstret: modellen hjælper med at skrive kode, og derefter beder man den samme model om at reviewe sin egen løsning. Det virker ofte fint, men det har også en indbygget svaghed. Den model, der lige har valgt en retning, har sjældent stærk motivation for at udfordre sine egne antagelser. Derfor er idéen med et Codex plugin til Claude Code mere vigtig, end den først ser ud.

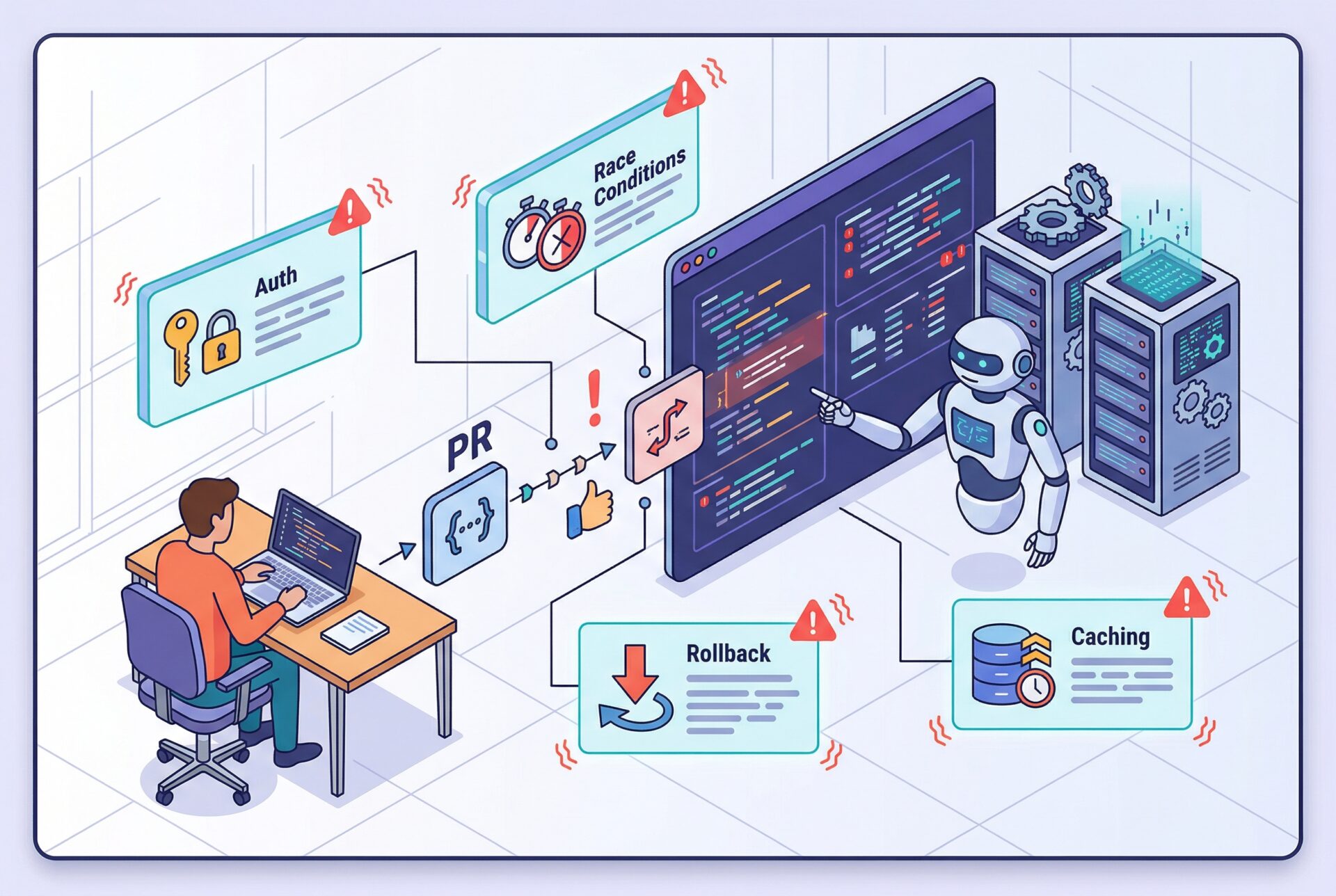

Med pluginet kan Claude Code fortsat være det sted, hvor du arbejder, mens Codex bruges som en slags andenopinion. Den normale review-kommando er read-only. Den mere interessante kommando er /codex:adversarial-review, som eksplicit er lavet til at presse på designvalg, tradeoffs, skjulte antagelser og risikoområder som auth, data loss, rollback, race conditions og reliability. Det er præcis dér, mange AI-assisterede workflows stadig er for svage.

For en udvikler betyder det noget helt konkret: review bliver ikke kun et sidste kosmetisk trin, men et særskilt kontrolpunkt. Du kan lade Claude Code bygge en løsning, og før du committer eller åbner en PR, kan du bede Codex om at lede efter det, som den første agent typisk overser. Det minder mere om et rigtigt team-flow end om klassisk autocomplete.

Det vigtige i praksis: samme maskine, samme repo, ny rollefordeling

Det smarte er, at pluginet ikke starter et separat, mystisk cloud-runtime. Ifølge OpenAIs egen dokumentation kører det via den lokale Codex CLI og Codex app server på samme maskine, med samme checkout og samme lokale konfiguration. Det betyder, at du ikke skal flytte arbejde over i et nyt system for at få værdien. Du bliver i den terminal og det repo, du allerede bruger.

Sådan installerer du pluginet i praksis med den metode, der faktisk virker:

- Installer først Claude Code lokalt:

curl -fsSL https://claude.ai/install.sh | bash - Installer derefter Codex CLI:

npm install -g @openai/codex - Log ind i Codex på forhånd:

codex login - Start Claude Code, og tilføj marketplace-kilden til pluginet med:

/plugin marketplace add openai/codex-plugin-cc - Installer derefter selve pluginet i Claude Code:

/plugin install codex@openai-codex - Reload plugins eller genstart Claude Code:

/reload-plugins - Verificér installationen ved at skrive

/codexog tjek, at kommandoer som/codex:setupog/codex:reviewdukker op.

Det vigtige her er, at pluginet ikke installeres med én enkelt shell-kommando. Først skal Claude Code og Codex CLI være installeret, derefter skal du logge ind i Codex, så marketplace tilføjes inde fra Claude Code, og til sidst installeres selve pluginet derfra.

Pluginet understøtter også en rescue-rolle. Med /codex:rescue kan du sende en konkret opgave videre til Codex, for eksempel at undersøge en flaky test, finde årsagen til en CI-fejl eller lave et hurtigt alternativt fix med en mindre model. Der er kommandoer til status, resultat og annullering, så lange jobs kan køre i baggrunden. Det er en ret moden detalje, fordi agentiske workflows falder sammen, hvis alt skal ske synkront i én session.

- Review: Brug Codex som read-only korrektiv på ucommittede ændringer eller en branch diff.

- Adversarial review: Brug Codex til at udfordre arkitektur, cache-strategi, retries, auth eller rollback-plan.

- Rescue: Send fejlsporing eller et afgrænset fix til Codex, mens du selv fortsætter andet arbejde.

Det er også værd at bemærke, at OpenAI skriver, at code review-runs i Codex går på GPT-5.3-Codex, mens øvrig brug afhænger af plan og modelvalg. Samtidig har OpenAI netop ændret dele af Codex-prissætningen for kreditter og tokenforbrug. Det gør det endnu vigtigere at tænke workflow i stedet for bare features: Brug den dyre, kritiske second opinion dér, hvor risikoen er høj, og ikke på hver eneste lille ændring.

Det her ændrer især workflows for teams, der allerede bruger AI tungt

Jeg tror, det her er mest interessant for teams, der allerede har accepteret, at AI skriver en mærkbar del af koden. Når den tærskel først er overskredet, bliver det næste store spørgsmål ikke “kan modellen kode?” men “hvordan bygger vi kontrolmekanismer ind, så vi ikke ophober teknisk og kognitiv gæld?” Her er et Codex plugin til Claude Code et konkret svar.

I stedet for at vælge én vinder mellem Claude Code og Codex kan man begynde at bruge dem som to forskellige roller. Claude kan være den hurtige samarbejdspartner, der former løsningen i dialog med dig. Codex kan være modparten, der kommer ind bagefter og spørger, om løsningen overhovedet burde se sådan ud. Den rollefordeling er mere værdifuld end endnu et benchmark-tal.

Det ligger også fint i forlængelse af den bredere udvikling, hvor agenter ikke længere kun vurderes på, om de kan skrive kode, men på om de kan indgå i et troværdigt udviklerworkflow med review, isolation, baggrundsopgaver og sporbarhed. Det var også pointen i mit tidligere indlæg om OpenAIs kamp for at indhente Claude Code, og det passer godt sammen med udviklingen i Claude Code Review.

Mit bud er derfor enkelt: Den virkelige nyhed er ikke, at OpenAI nu kan bo inde i Anthropic-værktøjet. Den virkelige nyhed er, at cross-provider review er ved at blive normalt. Når det sker, flytter konkurrencen sig fra “hvem skriver hurtigst kode?” til “hvem passer bedst ind i et workflow, hvor andre agenter må kontrollere resultatet?” Det er en langt mere moden fase af agentisk udvikling.

Kilder

- Codex plugin for Claude Code README — OpenAI GitHub, læst april 2026

- Pricing – Codex — OpenAI Developers, læst april 2026

- Introducing Codex Plugin for Claude Code — OpenAI Developer Community, april 2026

Denne artikel er skrevet i samarbejde med AI, og efterfølgende redigeret af et rigtigt menneske 🙂